인간처럼 창작하는 AI

최근 AI는 정해진 특정 작업을 수행하도록 프로그래밍 된 ‘전문가AI(Narrow AI), 특정 업무를 수행하는 AI’부터 다양한 업무 수행이 가능하고 인간과 흡사한 추론과 판단을 하는 ‘범용 AI(AGI, Artificial General Intelligence)’로 진화하고 있다.

이미지넷 챌린지(2010년~)와 알렉스넷(2012년)에서 딥 러닝 알고리즘이 소개되고, GAN(Generative Adversarial Network, 진짜 같은 데이터를 생성하려는 생성 모델과 진짜와 가짜를 판별하려는 분류 모델이 서로 적대적으로 학습해 진짜와 가짜의 구별이 어려운 데이터를 만들 수 있는 기술)의 등장(2014년)으로 딥 러닝을 통한 학습이 쉬워지면서 AI 성능이 비약적으로 발전하였다.

구글이 2017년 트랜스포머 알고리즘을 공개한 이후 자연어 처리 분야에서도 혁신이 일어나고 있다. 구글의 BERT(Bidirectional Encoder Representations from Transformers), 일론 머스크가 설립한 openAI 사의 NLP(Natural Language Processing) 모델인 GPT(Generative Pre-training Transformer) 등이 핵심이다. 특히 openAI 사가 개발한 GPT-3는 기존 어떤 모델보다도 인간의 언어 구조를 잘 이해하고 자연어 추론 성능이 우수하다. GPT-3는 기존에 공개된 마이크로소프트의 언어 모델보다 10배 이상 큰 1,750억 개의 매개 변수를 가진 초 대규모 모델이며, 범용 AI 모델로 진화하고 있다.

사람의 뇌에 있는 1,000억 개의 뉴런이 연결되어 처리할 수 있는 10조 개~100조 개에는 비할 수 없지만, 2000년 상반기까지 100억 개 내외였던 자연어 처리 시스템은 GPT-3에 이르러 1,750억 개의 매개 변수를 가지게 되었다. 2030년쯤에는 매개 변수 100조 개에 달하는 GPT-4를 공개할 예정이라고 한다. 발전 속도가 빨라 인간의 처리 능력 수준이 될 날도 멀지 않은 것 같다. 구글은 최대 1조 6,000억 개에 달하는 초거대 AI ‘스위치 트랜스포머(Switch Transformer)’를 공개했고, 중국 정부의 지원을 받는 연구소인 BAAI(The Beijing Academy of Artificial Intelligence)는 매개 변수가 1조 7,500억 개에 달하는 ‘우다오(WuDao) 2.0’을 공개했다.

openAI 사의 GPT는 자연어 처리의 병렬화를 통해 약 5천억 단어인 대규모 데이터 셋을 학습한다. 대화 맥락을 파악해 가장 적합한 단어를 이어가는 방식으로 훈련한다. 언어 예측 모델로 하나의 언어를 입력하면 이를 사용자에게 가장 유용한 다음 언어로 변환하도록 설계된 알고리즘 구조다. 문장과 같은 언어 구조를 만드는 방법을 배우기 위해 의미 분석을 사용해 맥락에 따른 단어의 의미 차이를 학습한다. 지도 학습의 경우처럼 True/False라는 정보를 포함하지 않고 단어와 문장의 사용법을 학습하고, 그것을 분해해 스스로 재구성하는 비지도 학습을 사용하는 것이다.

GPT-3는 인간의 두뇌와 같은 수준에서 작업을 수행하고 음성을 듣고 이해하며 복잡한 사고와 판단을 수행할 수 있는 지적 능력을 갖추고 있다. openAI 사가 구축한 텍스트와 위키 백과 등 인터넷을 탐색해 수집한 570GB의 텍스트 정보를 학습한다. 그래서 긴 텍스트의 요약문을 만들거나 에세이, 시를 쓰는 등의 과제 수행이 가능하고, 질문에 대해서도 정확하고 관련도가 높은 응답을 수행할 수 있다. 추론 서비스 API로 자연어를 프로그래밍 언어로 변경해 스스로 코딩하고, 시나리오를 제작하는 등 창작 영역에서도 성능을 발휘하고 있다.

openAI 사는 GPT-3을 활용해 텍스트 문장으로 설명하면 그림을 그려주는 AI 화가 DALL-E를 공개하며 창작과 예술의 영역에서의 가능성을 확인하고 있다. 텍스트와 맥락 정보만 입력하면 컴퓨터가 스스로 코딩을 해서 디자인과 설계를 한다. 코딩을 할 줄 몰라도 디자인적 영감을 얻기 위한 보조적 도구로 활용이 가능할 것으로 전망하고 있다.

자연어 처리 모델은 문법 교정, 번역, 게임 · 영화 스토리 생성, 검색 엔진 성능 개선, 개인 비서 등 다양한 애플리케이션 개발을 촉진할 것으로 기대된다. IoT, 가전, 스마트 기기 등과 결합해 혁신적인 서비스 출시가 가능해지고, 음성 기술, 추론 능력의 향상으로 서비스 고도화도 가능할 것이다. 특히 챗봇의 기능을 더욱 강화하고 음성 AI 기술, 감정 분석 기술과 결합해 챗봇이 일상생활에서 사용될 수 있을 것으로 예상된다.

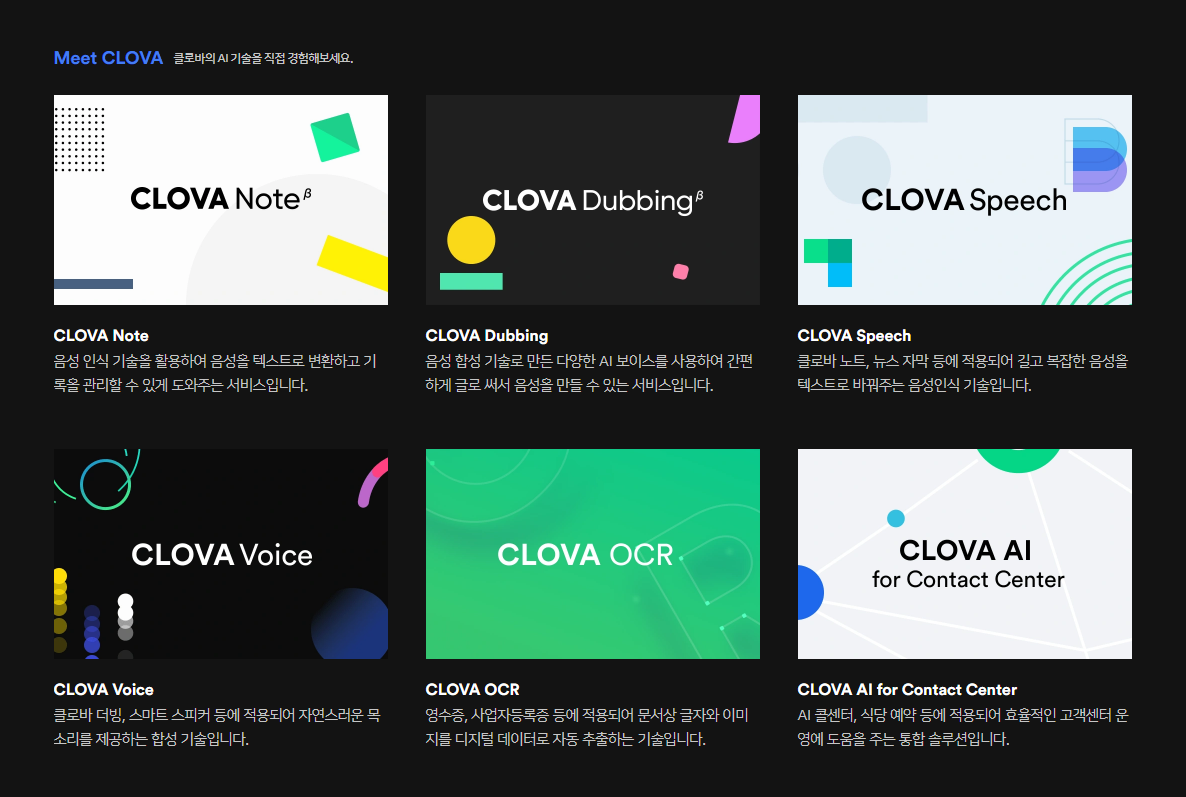

국내 IT 대기업들도 ‘초 거대 AI(hyperscale AI)’개발에 나섰다. 네이버가 국내 최초의 초 거대 AI 모델인 ‘하이퍼 클로바(Hyper CLOVA)’를 공개했다. AI의 매개 변수 수가 GPT-3보다 많은 2,040억 개라고 한다. 하이퍼 클로바의 자연어 데이터 학습량은 GPT-3의 6,500배 이상이고, 학습량의 97 퍼센트가 한국어다. 우리 언어로 된 다양한 서비스를 개발할 수 있는 기반이 마련된 셈이다. LG그룹도 6,000억 개의 매개 변수를 가진 초 거대 AI를 공개할 예정이며, KT와 SKT, 카카오 등도 초거대 AI 확보를 서두르고 있다.

'컴퓨터·IT > <노코딩 AI >' 카테고리의 다른 글

| 07. 몇 줄의 코드로 하는 AI_텐서플로 (1) | 2022.07.02 |

|---|---|

| 06. 마케팅 단계별 AI 기술 (2) | 2022.07.01 |

| 04. 투자 의사 결정의 핵심, CEO의 혁신 역량 (1) | 2022.06.29 |

| 03. CEO의 역할 변화 (3) | 2022.06.28 |

| 02. AI 기술 적용 프로세스별 직무 (2) | 2022.06.27 |

댓글